Codex — агентное приложение для написания и отладки кода от OpenAI — перешёл на GPT-5.5 и теперь работает на стойках NVIDIA GB200 NVL72. Сама NVIDIA стала первым крупным корпоративным пользователем: более 10 000 сотрудников компании получили доступ к инструменту, причём не только инженеры, но и юристы, маркетологи, финансисты и HR-специалисты.

Агентные системы отличаются от обычных чат-ботов тем, что способны самостоятельно выполнять многошаговые задачи: читать файлы, запускать код, итерировать по результатам и возвращать готовый результат. Codex работает именно так — пользователь описывает задачу на естественном языке, агент разбирает кодовую базу, вносит изменения и тестирует их. По данным NVIDIA, циклы отладки, которые раньше растягивались на несколько дней, теперь завершаются за часы, а эксперименты, требовавшие недель, укладываются в ночные прогоны.

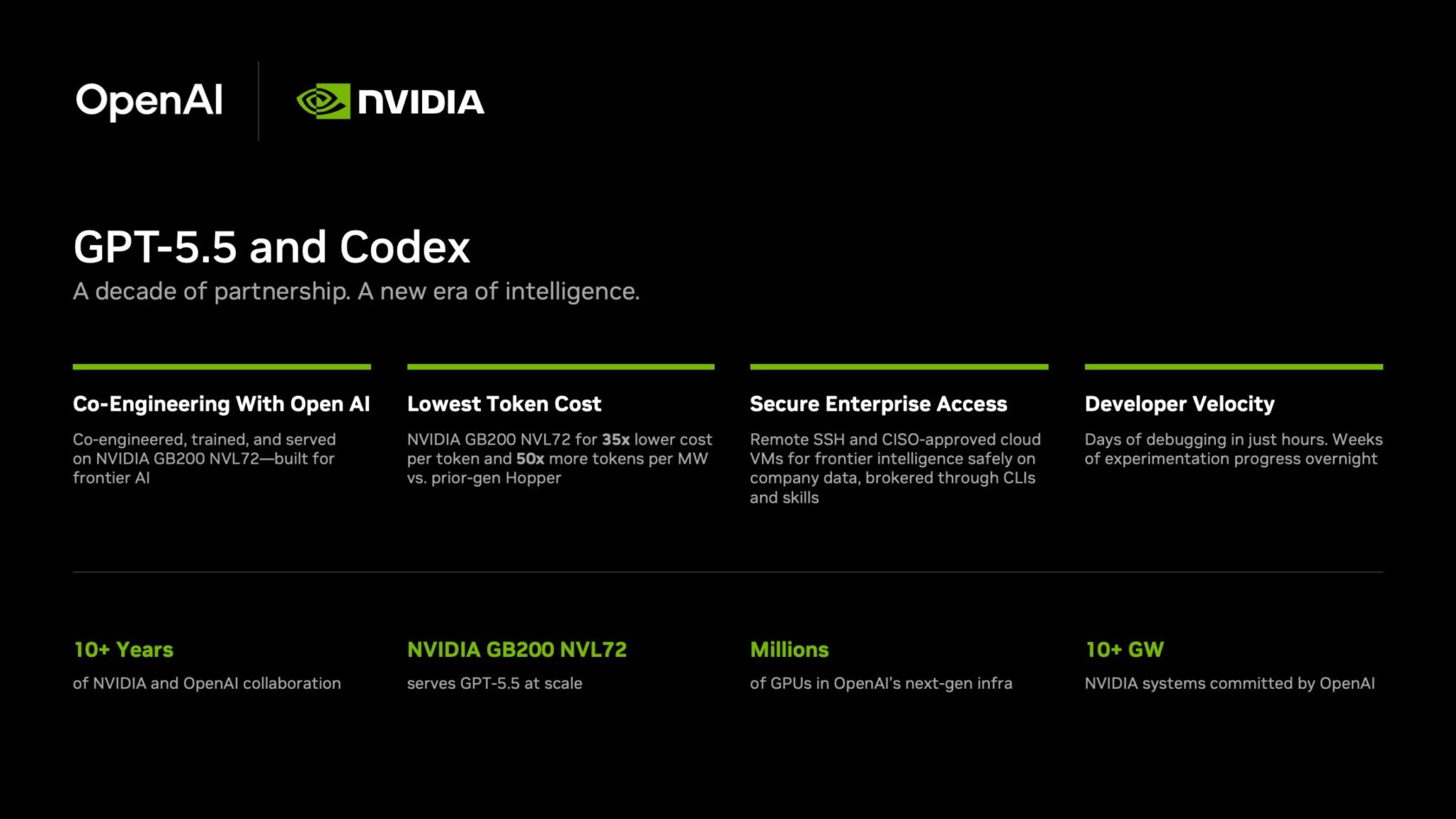

Производительность стала возможной в том числе благодаря аппаратной платформе. GB200 NVL72 — это стоечная система масштаба rack-scale, объединяющая 72 GPU Blackwell. По сравнению с предыдущим поколением она обеспечивает стоимость инференса в 35 раз ниже на миллион токенов и в 50 раз большую скорость генерации токенов на мегаватт потребляемой мощности. Именно эти характеристики делают запуск фронтирных моделей экономически оправданным в корпоративном масштабе — раньше стоимость инференса GPT-класса ограничивала массовое использование.

Codex поддерживает SSH-подключения к изолированным облачным виртуальным машинам с политикой нулевого хранения данных и доступом к продакшн-системам только на чтение.

Для корпоративного развёртывания NVIDIA решила задачу безопасности через изоляцию: каждый сотрудник получил отдельную облачную виртуальную машину, в которой работает его агент. Codex подключается к ней по SSH, а политика нулевого хранения данных (zero-data retention) исключает сохранение корпоративной информации на стороне OpenAI. Доступ агента к продакшн-системам ограничен режимом только для чтения через командную строку и набор автоматизационных инструментов Skills, которые NVIDIA использует для внутренних рабочих процессов.

За развёртыванием стоит более чем десятилетняя история сотрудничества двух компаний. В 2016 году Дженсен Хуанг лично привёз первый суперкомпьютер DGX-1 в офис OpenAI в Сан-Франциско — с этого момента началось партнёрство, охватившее весь стек: от кремния до программных фреймворков. NVIDIA стала партнёром нулевого дня при запуске открытых весов gpt-oss, оптимизировав их для TensorRT-LLM, vLLM и Ollama. Совместно компании запустили первый кластер GB200 NVL72 на 100 000 GPU, на котором были проведены несколько крупных тренировочных прогонов. GPT-5.5 — прямой результат работы этой инфраструктуры. OpenAI, в свою очередь, обязалась развернуть более 10 гигаватт систем NVIDIA для следующего поколения своей инфраструктуры.