AWS опубликовала пошаговое руководство по построению ИИ-агентов с использованием open-source Strands Agents SDK и моделей, развёрнутых на SageMaker AI endpoints. В качестве рабочих примеров выбраны Qwen3-4B и Qwen3-8B — модели от Alibaba, доступные через SageMaker JumpStart. Полный код опубликован в репозитории на GitHub в виде Jupyter-ноутбука.

Strands Agents SDK — относительно молодой open-source инструмент, который позиционируется как «model-driven» подход к агентам: разработчик описывает модель, системный промпт и набор инструментов, а SDK берёт на себя оркестрацию. SDK поддерживает множество провайдеров, включая Amazon Bedrock и теперь SageMaker AI. Для работы с SageMaker достаточно передать имя endpoint и параметры вывода — temperature, max_tokens, режим стриминга — через объект SageMakerAIModel. Единственное техническое требование: развёрнутая модель должна поддерживать OpenAI-совместимый API chat completions.

| Параметр | Amazon Bedrock | SageMaker AI endpoint |

|---|---|---|

| Контроль над инстансом | Нет | Полный (тип, регион, сеть) |

| Кастомные fine-tuned модели | Ограниченно | Да |

| Data residency | Зависит от региона сервиса | Явный выбор региона и VPC |

| A/B-тестирование вариантов | Нет встроенного | Через MLflow metrics |

| Операционная нагрузка | Минимальная | Выше, managed-слой AWS |

Главный мотив для выбора SageMaker вместо управляемого Bedrock — контроль над инфраструктурой. Bedrock удобен, когда нужна скорость запуска и не важно, на каком железе и в каком регионе работает модель. SageMaker AI endpoints, напротив, позволяют зафиксировать тип инстанса (в примере — ml.g5.2xlarge с GPU NVIDIA A10G), настроить сетевую топологию, управлять масштабированием и выбирать регион хранения данных. Для компаний с требованиями GDPR, отраслевыми регуляторными ограничениями или внутренними политиками data residency это принципиально. Кроме того, SageMaker поддерживает развёртывание кастомных fine-tuned моделей — не только тех, что есть в каталоге JumpStart.

Модели Qwen3-4B и Qwen3-8B из SageMaker JumpStart разворачиваются на инстансе ml.g5.2xlarge за несколько строк кода.

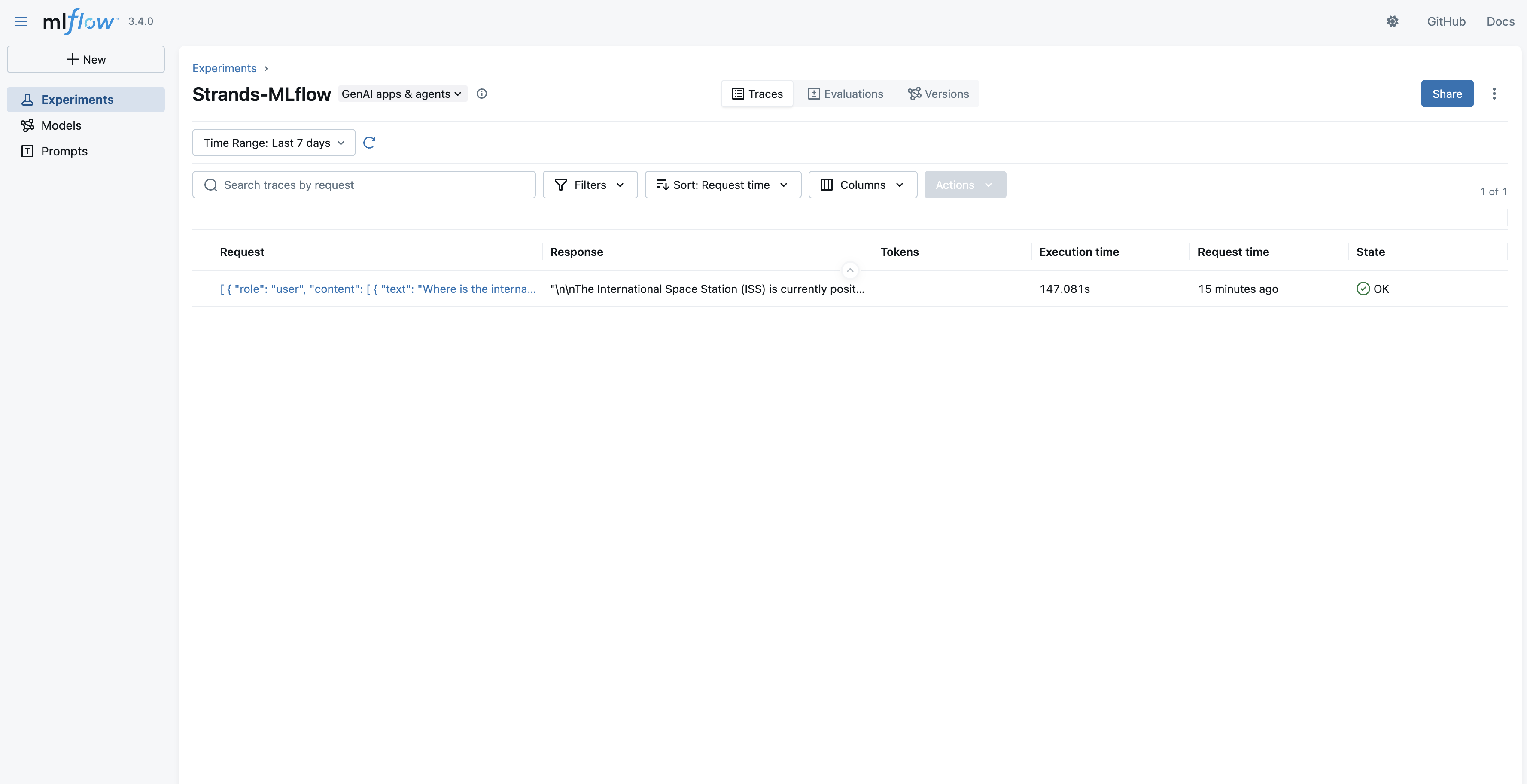

Наблюдаемость агентов реализована через SageMaker Serverless MLflow. MLflow — широко используемый open-source инструмент для управления жизненным циклом ML-моделей: трекинг экспериментов, версионирование, деплой. В контексте агентов SageMaker MLflow автоматически захватывает трассировки выполнения — какие инструменты вызывал агент, в каком порядке принимались решения, какие метрики получены на выходе. Это происходит без написания кастомного кода инструментации, что снижает порог входа для команд, которые только начинают строить production-агентов.

Отдельный блок руководства посвящён A/B-тестированию: два варианта модели (Qwen3-4B и Qwen3-8B) разворачиваются как отдельные endpoints, агент прогоняется через оба, результаты сравниваются через MLflow metrics. Такой подход позволяет принимать решение о выборе модели на основе измеримых показателей качества и стоимости, а не интуиции. Для высоконагруженных систем разница в цене между 4B и 8B моделью при сопоставимом качестве может быть существенной.

В более широком контексте публикация отражает тренд на «инфраструктурный суверенитет» в корпоративном ИИ. Управляемые API вроде Bedrock или OpenAI снижают операционную нагрузку, но забирают контроль. Strands + SageMaker — это попытка AWS предложить компромисс: managed-операционный слой облака при сохранении архитектурного контроля над тем, где и как происходит инференс.