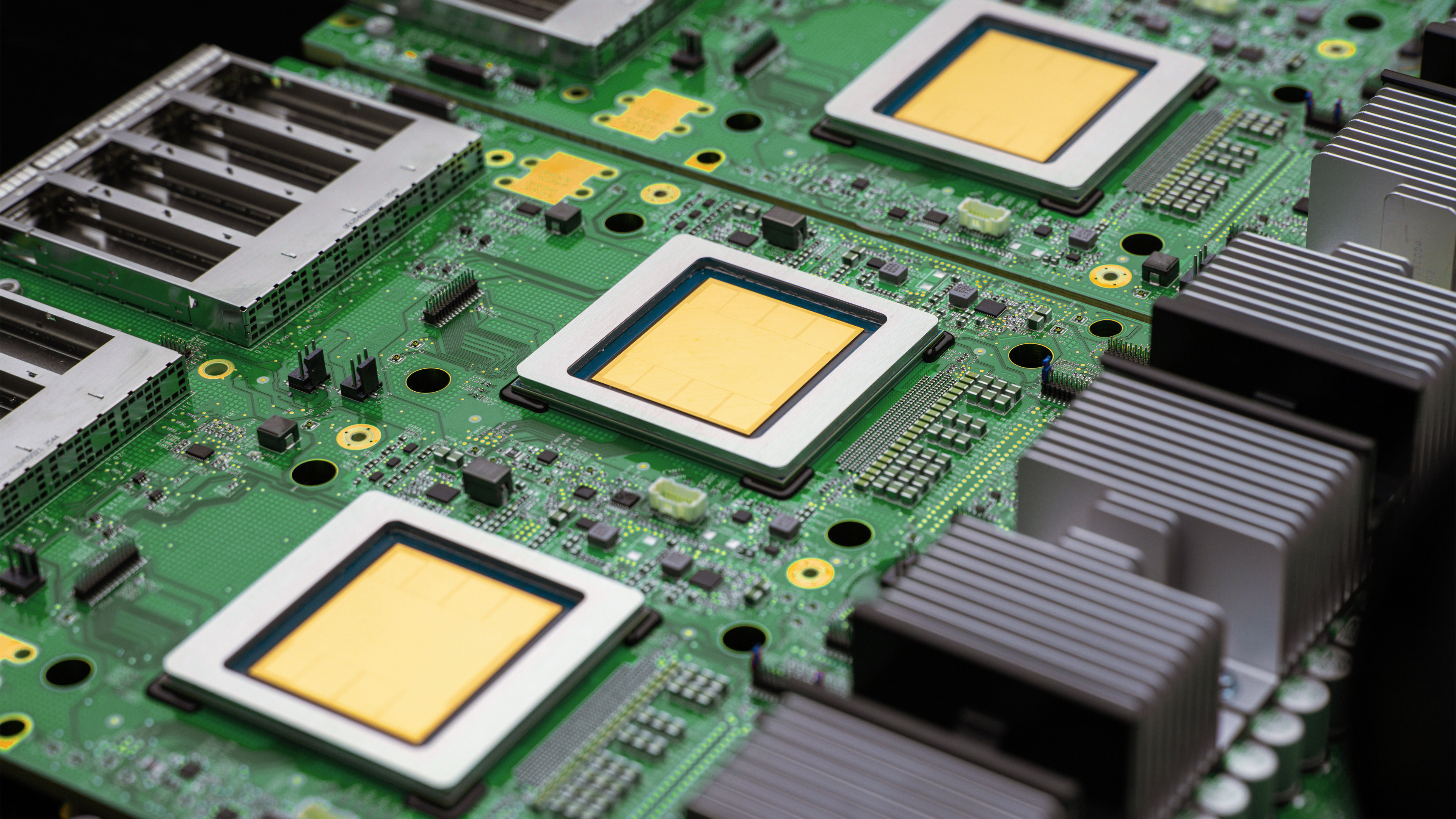

Google выпустила восьмое поколение своих фирменных ускорителей, разделив линейку на два специализированных чипа: TPU 8t для обучения моделей и TPU 8i для их запуска. Это отход от прежней логики, при которой один чип выполнял обе задачи. Предыдущее поколение — Ironwood — было анонсировано в 2025 году и стало седьмым в серии Tensor Processing Unit, которую Google развивает с 2016 года как альтернативу GPU-инфраструктуре Nvidia.

TPU (Tensor Processing Unit) — специализированный процессор, оптимизированный под матричные вычисления, которые лежат в основе обучения и работы нейросетей. В отличие от GPU, изначально созданных для графики и лишь адаптированных под ИИ-задачи, TPU проектировались с нуля под нужды машинного обучения. Google использует их как основу собственной облачной ИИ-инфраструктуры и предоставляет сторонним разработчикам через Google Cloud.

Тренировочный чип TPU 8t объединяется в кластеры («поды») по 9600 единиц с двумя петабайтами общей высокоскоростной памяти. Производительность одного пода — 121 EFlops в формате FP4, что в 2,8 раза выше потолка Ironwood. Google утверждает, что архитектура допускает линейное масштабирование до миллиона чипов в одном логическом кластере. Показатель «goodpute» — доля времени, когда чип реально продвигает обучение, а не простаивает из-за сбоев или неравномерного доступа к памяти, — заявлен на уровне 97%. Это достигается автоматической обработкой аппаратных сбоев и телеметрией в реальном времени по всем подключённым чипам.

TPU 8i оптимизирован для инференса: кластер вырос с 256 до 1152 чипов, объём SRAM на чипе утроен до 384 МБ.

TPU 8i решает другую задачу. Инференс — режим, в котором обученная модель отвечает на запросы пользователей — требует не максимальной вычислительной мощности, а низкой задержки и эффективной работы с несколькими параллельными агентами. Кластер TPU 8i вырос с 256 чипов у Ironwood до 1152, а объём SRAM на каждом чипе утроен до 384 МБ. Больший кэш позволяет хранить на чипе расширенный KV-кэш — структуру данных, критичную для моделей с длинным контекстом. Суммарная производительность пода — 11,6 EFlops, значительно меньше, чем у TPU 8t, что отражает разную природу задач.

Оба чипа восьмого поколения первыми в линейке полностью перешли на ARM-процессоры Axion собственной разработки Google. Прежде каждый x86-процессор обслуживал четыре TPU; теперь соотношение изменилось до одного Axion на два TPU. Google называет это «полностековым» ARM-подходом и связывает с ним рост энергоэффективности: по заявлению компании, производительность на ватт удвоилась относительно Ironwood. Центры обработки данных, по словам Google, «совместно спроектированы» с чипами: интеграция сети и вычислений на одном кристалле и оптимизированная компоновка подов дали шестикратный рост вычислений на единицу потреблённой электроэнергии. Система жидкостного охлаждения четвёртого поколения адаптирована под новые чипы с активным управлением потоком воды в зависимости от нагрузки.

Оба ускорителя поддерживают стандартные фреймворки — JAX, PyTorch, MaxText, SGLang и vLLM, — что снижает порог входа для сторонних разработчиков. В перспективе TPU 8t и TPU 8i станут основой для агентов на базе Gemini. Реакция рынка оказалась сдержанной: акции Nvidia после анонса упали примерно на 1,5%, но быстро вернулись выше $200. Спрос на ИИ-ускорители за последний год более чем удвоил капитализацию Nvidia, и единичный анонс конкурента пока не меняет расстановку сил.