Дефицит GPU-мощностей стал одной из главных операционных проблем для ML-команд: спрос на ускорители для обучения и инференса устойчиво опережает предложение. AWS описала два инструмента, которые позволяют зафиксировать доступ к GPU-инстансам на конкретный временной промежуток — EC2 Capacity Blocks for ML и SageMaker training plans.

EC2 Capacity Blocks for ML — это механизм резервирования GPU-мощностей непосредственно на уровне виртуальных машин Amazon EC2. Пользователь сам управляет операционной системой, сетью и оркестрацией. Бронирование открывается за восемь недель до старта; минимальная длительность — один день, максимальная — 182 дня (с шагом 7 дней для периодов свыше двух недель). В одном блоке можно зарезервировать до 64 инстансов, а через механизм AWS Organizations — до 256 инстансов одновременно на одну дату, если задействовать минимум четыре блока. Поддерживаемые семейства инстансов — P5, Trn1 и Trn2. Стоимость фиксируется в момент покупки и не меняется, даже если к моменту старта резервирования AWS скорректирует прайс. Скидка к on-demand составляет 40–50%: например, p5.48xlarge в регионе US East (N. Virginia) обходится в $34.61/ч против $55.04/ч по on-demand.

| Параметр | EC2 Capacity Blocks | SageMaker training plans | On-demand | Spot |

|---|---|---|---|---|

| Скидка к on-demand | 40–50% | 70–75% | — | до 90% |

| Гарантия доступности | Да | Да | Нет | Нет |

| Управление инфраструктурой | Пользователь | AWS | Пользователь | Пользователь |

| Среда | EC2 | SageMaker | EC2 / SageMaker | EC2 |

| Максимальный срок | 182 дня | Не указан | — | — |

| Предоплата | Да | Да | Нет | Нет |

| Риск прерывания | Нет | Нет | Нет | Да |

SageMaker training plans работают иначе: они предназначены для рабочих нагрузок внутри управляемой среды Amazon SageMaker — тренировочных заданий, кластеров HyperPod и инференса. Пользователь не занимается провизионингом инстансов вручную — SageMaker берёт это на себя. Скидка здесь выше: 70–75% к on-demand. Поддерживаются NVIDIA GPU и ускорители AWS Trainium; G-type инстансы (кроме G6) пока недоступны. Два инструмента не взаимозаменяемы: Capacity Blocks нельзя использовать с SageMaker-managed инстансами вроде ml.p4dn или ml.p5, а SageMaker training plans не применимы к прямым EC2-инстансам.

SageMaker training plans дешевле on-demand на 70–75% и управляют инфраструктурой автоматически.

До появления этих инструментов основными вариантами были on-demand инстансы и spot-инстансы. On-demand удобны для разовых экспериментов, но не гарантируют доступность при повторном запуске — это вынуждает держать инстансы запущенными дольше необходимого. Spot-инстансы снижают затраты до 90%, однако могут быть прерваны в любой момент, что делает их пригодными только для задач с поддержкой чекпоинтов и повторного запуска. On-demand capacity reservations (ODCR) существовали и раньше, но краткосрочная доступность для GPU-инстансов типа P была ограничена, а без долгосрочного контракта они тарифицируются по on-demand ценам без какой-либо скидки.

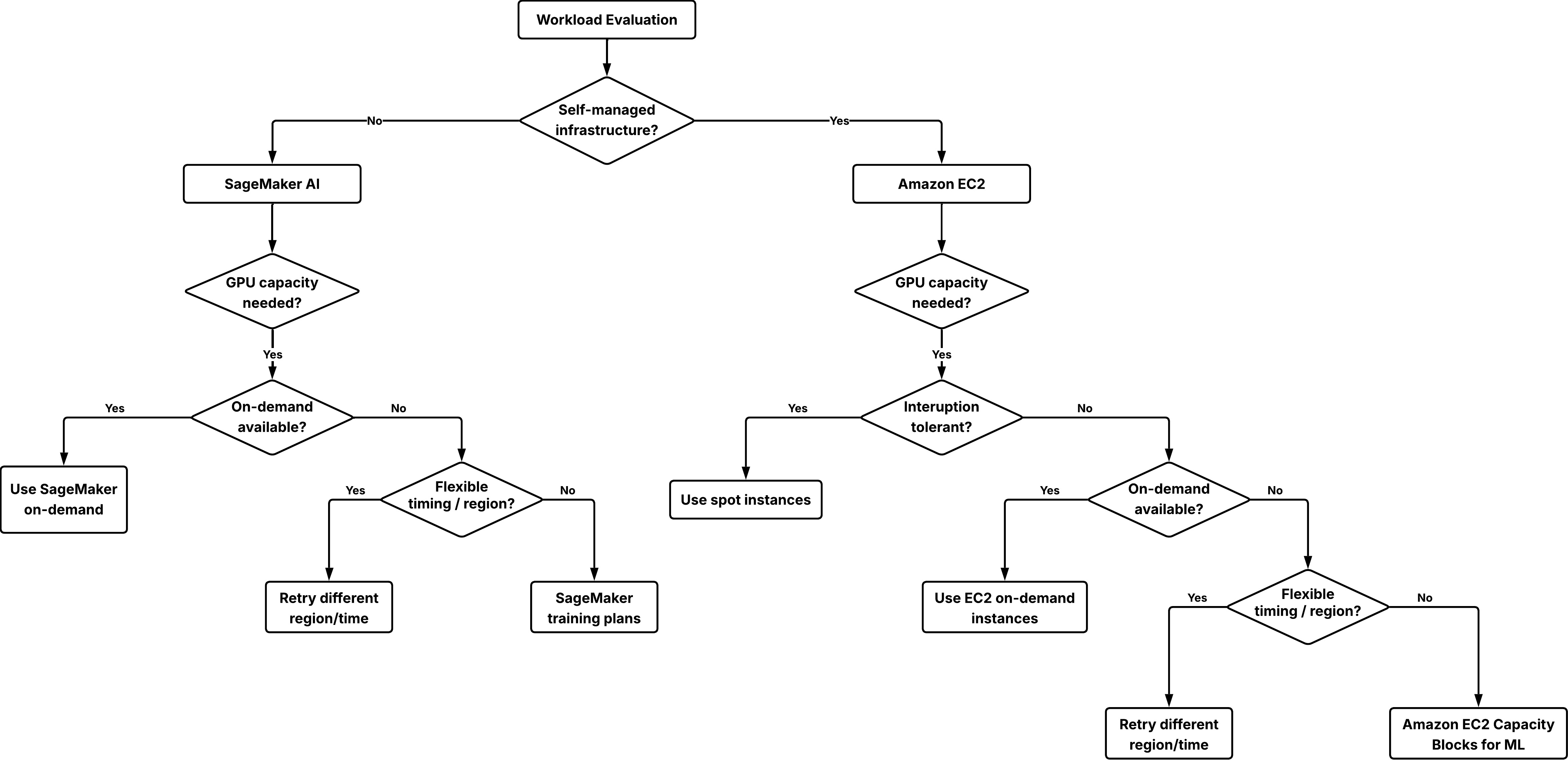

При выборе между двумя новыми инструментами AWS рекомендует ориентироваться на три параметра: среду выполнения (EC2 напрямую или SageMaker), требуемую степень контроля над инфраструктурой и ценовую модель. Для производственных развёртываний или крупных мероприятий с высокой потребностью в GPU AWS советует начинать планирование минимум за три недели и привлекать аккаунт-менеджера. Оба инструмента требуют предоплаты, поэтому если инстансы не будут загружены на протяжении всего зарезервированного периода, итоговые расходы могут превысить стоимость on-demand.